在 2026 年,AI 内容创作的核心不再是"选哪个模型",而是:如何把多个模型组合成一个工作流。

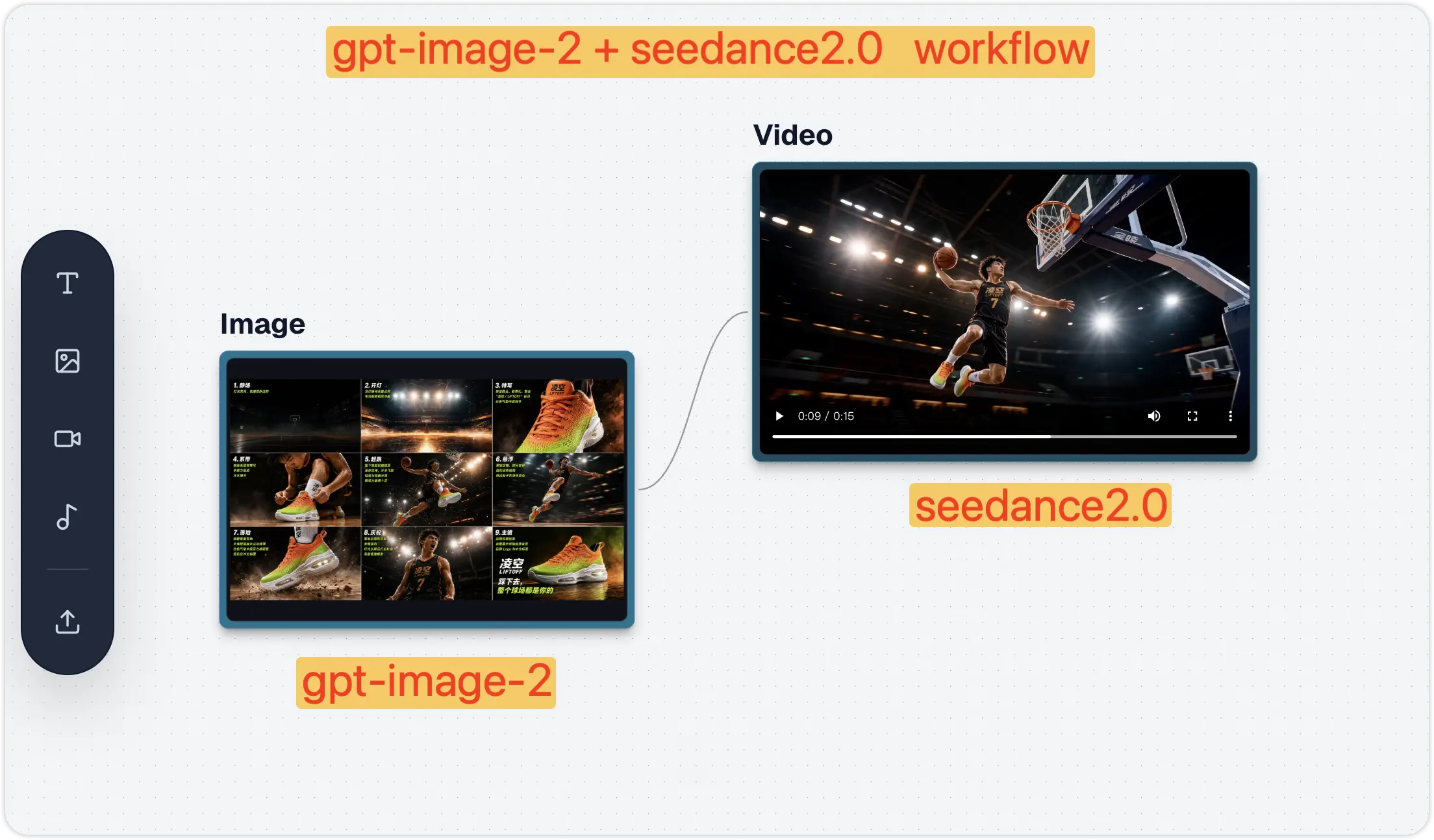

其中一个非常实用且效果突出的组合是:GPT Image 2 + Seedance 2 。

简单理解:

GPT Image 2 → 负责生成高质量画面(关键帧 / 分镜)

Seedance 2 → 负责让画面动起来(视频 / 动作 / 镜头)

把两者结合,你可以从一张分镜图,直接生成完整的视频——广告、短片、教学、游戏过场,都适用。

为什么 GPT Image 2 + Seedance 2 比单独使用效果更好?

单独使用的问题:

工具 问题

GPT Image 2 只能出图,不能动

Seedance 2 直接生成容易"画面不稳定"、"人物变形"

组合后的优势

画面更稳定 —— 先用 GPT Image 2 定义人物和风格,避免视频中"脸变形"

分镜更可控 —— 你可以提前设计每一帧,而不是让模型随机生成

视频质量更高 —— Seedance 只负责"动",不负责"设计",分工明确效果更好

创作效率更高 —— 你可以快速生成、测试、修改和对比不同创意方向

本质一句话:GPT Image 2 决定"长什么样",Seedance 2 决定"怎么动"。

为什么分镜图是 Seedance 2 成功的关键?

单张图和分镜图差距为什么这么大?

因为单张图片的信息量不足以让视频模型理解你的完整意图——你脑子里有运镜顺序、镜头角度、叙事节奏

但这些信息单张图表达不出来。而分镜图把它们全部编码成了一张图,Seedance 2 一看就懂。

核心技巧:「动机式连续运镜」

这个技巧来自电影导演斯皮尔伯格的运镜理念——每一次镜头移动都必须有"动机"( Motivated Camera Move )。镜头不是随意摆动,而是跟随场景中的动作自然转移注意力:马车横穿时镜头跟拍马车、横幅摆动后露出逃跑的鸡群、男孩追鸡跑过酒馆门时镜头顺势滑入酒馆。

在分镜图中标注好每个运镜方向和动机,Seedance 2 就能精准执行你想要的镜头语言。

完整工作流+案例视频+ 提示词+ 技巧 在这里

1

Untamed 11h 34m ago

感谢 学到了

|

2

billzhuang 11h 1m ago via iPhone

Severance 2 哪家供应管饱价格公道

正规的 |

3

StarrySky25 10h 21m ago

学到了学到了

|

4

sdasgasrgsdg 10h 10m ago

这不就是类似 tapnow 的产品么?现在 seedance 自己也有无限画布,独一档,tapnow 这类产品后续都得凉凉。年初刚和一个初创团队合作类似产品,马上做完了,运营也起来了,seedance2 一出,产品直接叫停。为啥? seedance 独一档,无限画布没啥存在必要了,用户调研也是倾向于直接使用 seedance

|

5

yutian666 OP @sdasgasrgsdg 即梦限制太严重,比如真人审核。

|