直接上菜:GenericAgent

https://github.com/lsdefine/GenericAgent

本人基本信息:国内某 top3 的计算机博士在读,大模型方向。

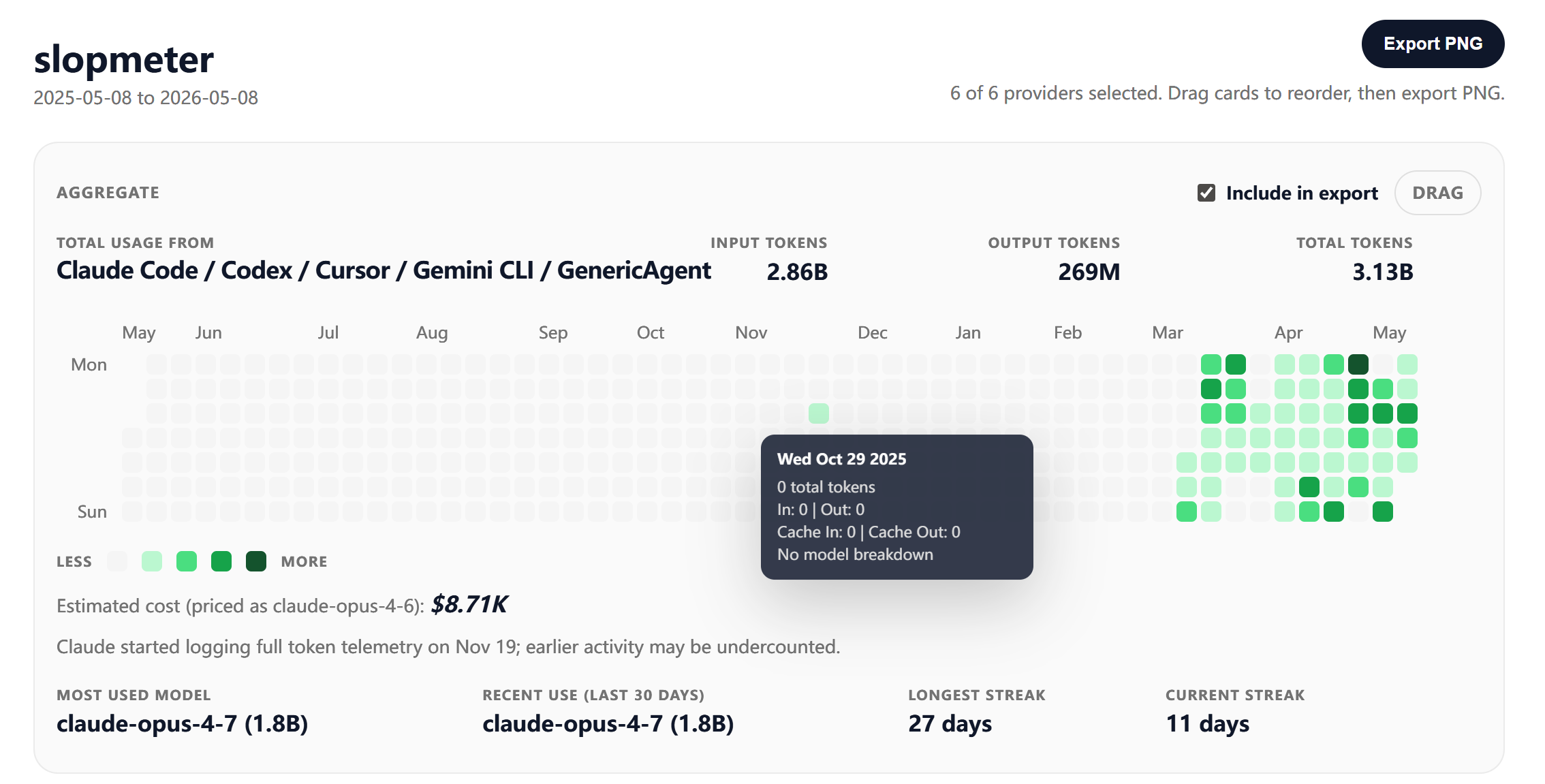

最近对 cc 的使用情况:

我最近在 github trending 上关注了 GA 这个项目,并高强度使用了一周多(完全接管我的科研+生活),然后我就卸载了 cc 、codex 和 openclaw(但是感谢 cc 曾经在我的生命中出现过,不过 openclaw 你是真的垃圾啊)。。

那么有人问了,cc 那么屌,openclaw 被吹的那么神,有什么问题? 我想但凡用过的人此时在心里都有答案了。。

下文的数据来自 arxiv.org/abs/2604.17091,也就是 GA 的技术报告,里面有些 insights 我非常喜欢,而且我的风格也是用数据说话。

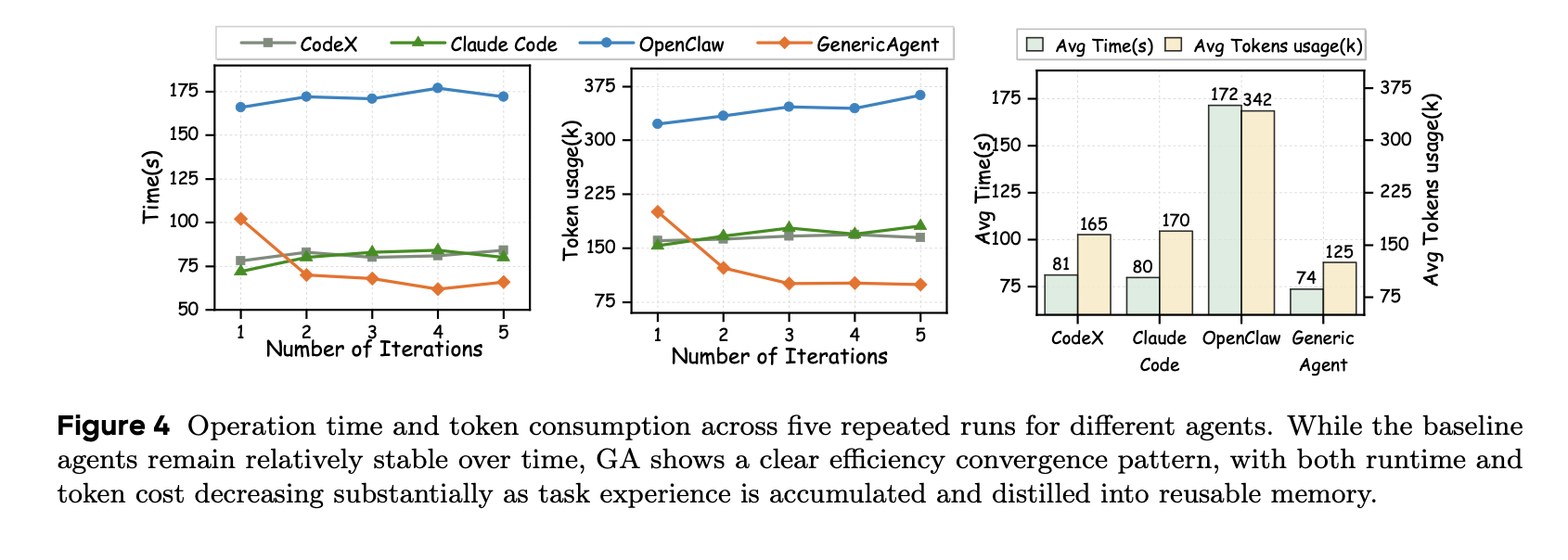

一、你的钱包顶得住吗?

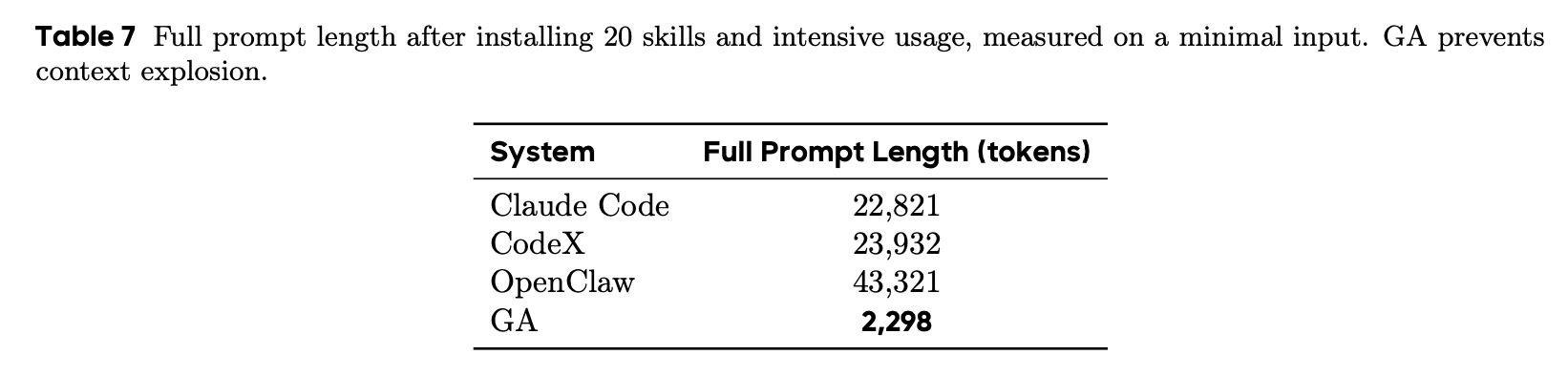

打一个招呼,oc 要用 4w tokens ,cc 和 codex 也是 2w tokens 打底了,真当我 token 不是花钱买的?

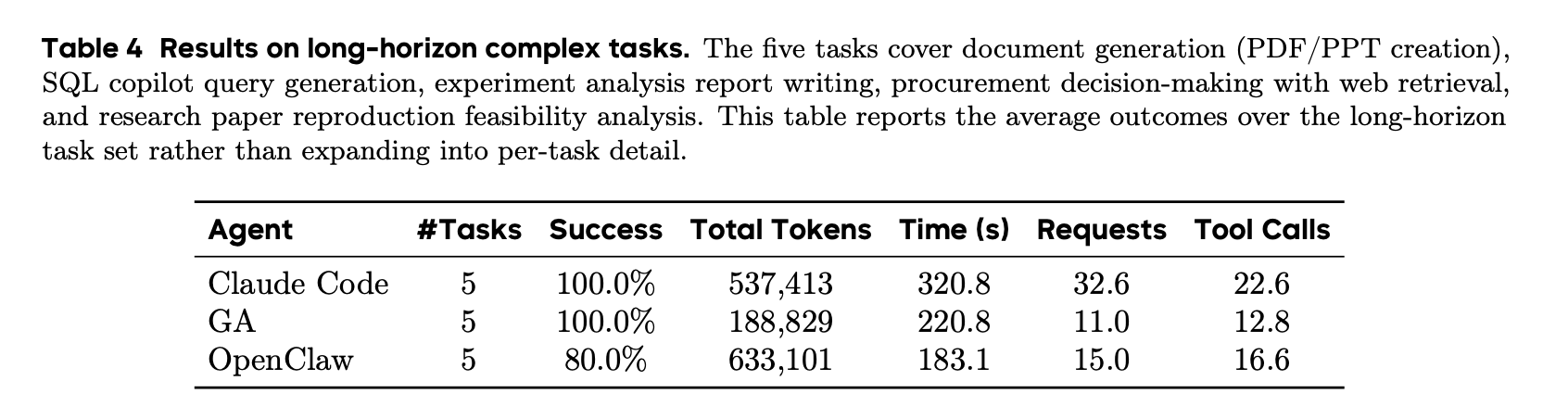

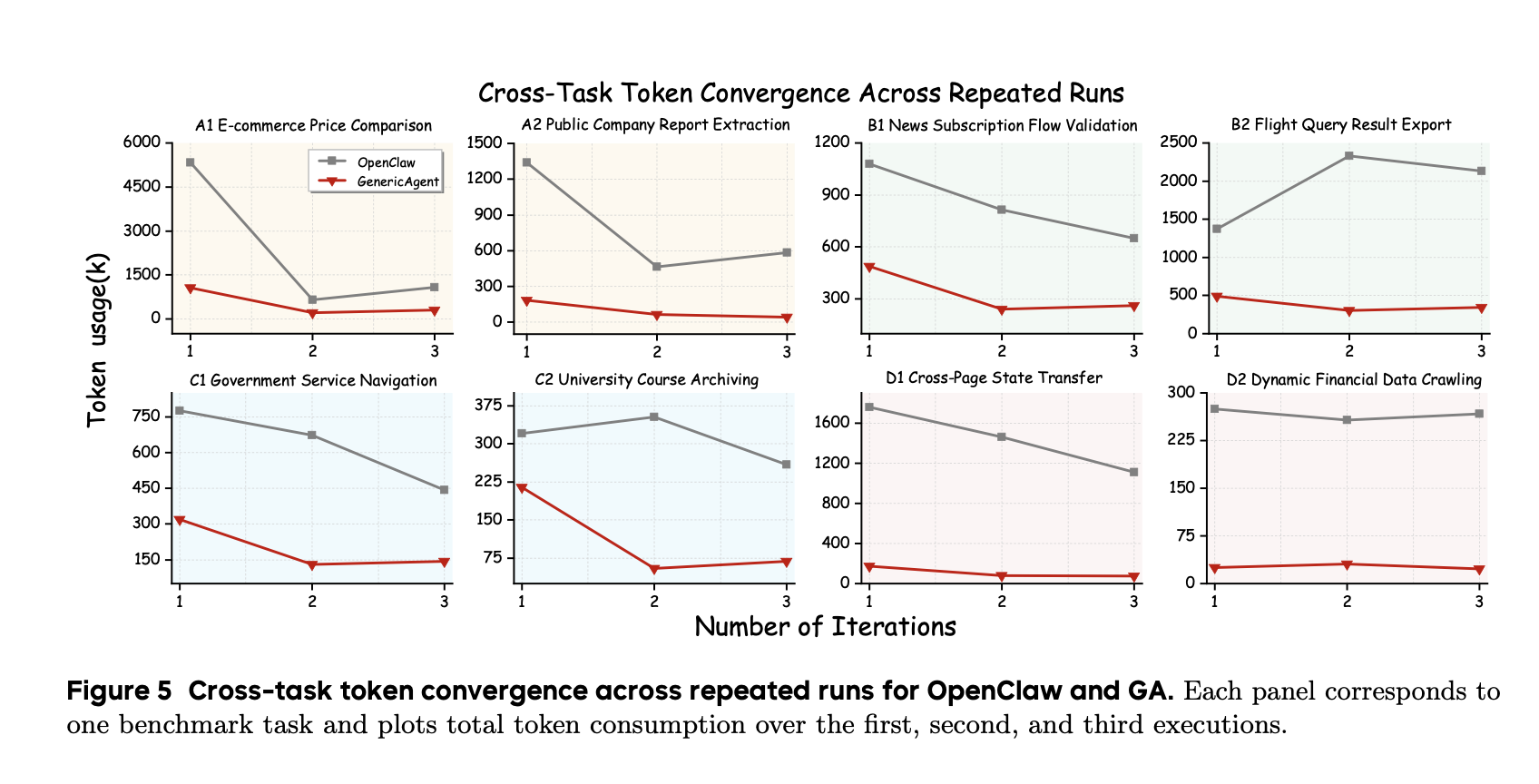

在长程任务上,GA 能够用更少的预算( 1/3 或者更少)获得一样甚至更好的效果。

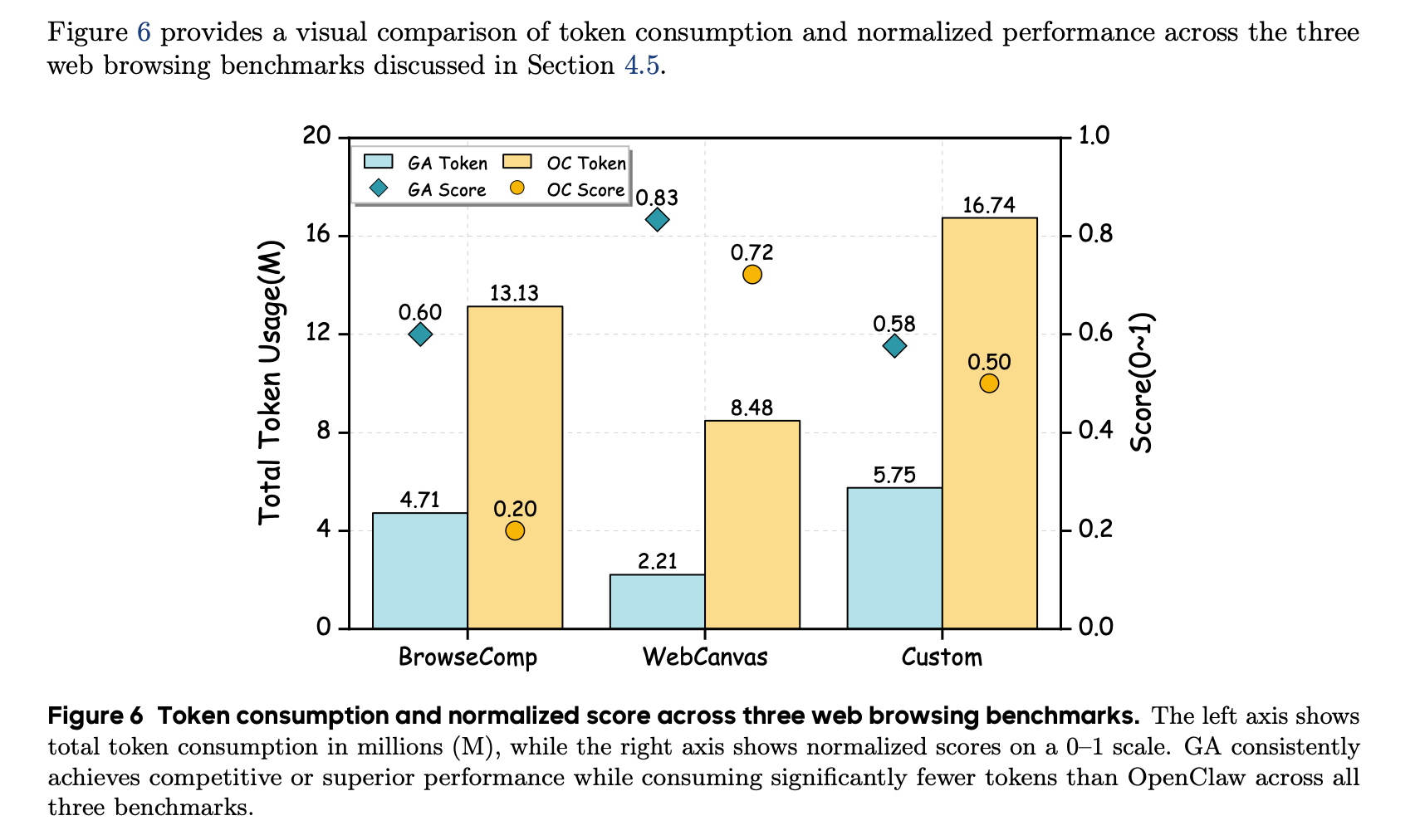

GA 有无敌的原生浏览器操作,能用非常夸张的极低的预算(1/5 左右)实现非常非常 nice 的网页搜索、浏览器操作(1-3 倍的成功率)。

插个题外话,我就是做 deepresearch 的,论文里选的 browsecamp 、webcanvas 这些数据集是非常有挑战的,也给我打开新世界了 hh

最近看大家都在流行 claude code 的各种 web 插件,我的嘴角慢慢上扬。 说实话,ga 的原生浏览器操作吊打所有的 web 插件,不服来战(本人已服)。

二、更好用的智能体一定能自进化

这也是最近 hermes 风头正盛的原因。在这一点上,我认为 GA 做的更好。

不要谈参数自进化,因为我认为的自进化就是 agent 对错误经验的总结学习,就像人的进化就是在直立行走之后能够制造和使用工具,而不是长出第六根手指。

直接上结果,oc 就不谈了,纯垃圾。。看 codex 和 cc ,实际上由于这两者的定位( coding ),所以他们是不会自主的总结重复的工作经验的。如果你每次都让他们做一些崭新的项目,那当然没问题,但是你要是让他们去追踪股票,能够按你一句话帮你去网上填表,去做你日常做的操作,那他们每次探索的成本则是巨大的。

GA 的自进化机制让 GA 得以越用越快,越用越方便(最后甚至能到心领神会的地步。。)

依旧吊打 oc ,oc 赶紧下桌吧。。

三、好的智能体离不开记忆

我知道大家这时候说了,LLM-Wiki 很吊,Evermemos 很吊,Mem0 很吊,我装这些插件就能让我的智能体有记忆。

先不谈这几个插件到底真实性能怎么样,我作为一个看了很多 memory 论文的从事大模型的人来说,作为一个 agent 的 memory 框架:

测 Locomo 、LongtermMem 这几个数据集就是不合适的! 现在的大模型的记忆不再是 user-centric 了!现在我们需要的大模型记忆是 task-centric,这两者有本质的区别。

所以,停止人云亦云吧。。

我深扒了 GA 的记忆设计,其简洁性和有效性真的令人印象深刻,但是在这里就不展开(如果大家感兴趣,我可能再开一篇帖子详细讲讲)。

我现在对 GA 的使用如图:

有什么记不得的,直接问就好了。。太 tm 牛逼了。

彩蛋

另外,我是第一次在 V2EX 发帖,发现这图床都要买。。然后也让 GA 给我整了一个,就一句话:

嘿嘿。。最后放一张 GA 自己的 skillhub 里的截图,懂的人自然知道干啥用的。

写在最后

还有很多没提到的,大家自己尝试就好了。当然 GA 也有很多让我不爽的地方,比如极其简陋的前端,然后我就在 GA 的群里潜水,最后发现了,大概是开发者的个人风格就是毛坯房的风格。。问他能不能给整好看点,他回答也简单:

他说 "你让 GA 给你做"。。真的无敌了。。

我不允许还有人不知道 GA !!!!

如果这个帖子有点热度,大家有要求的话,我可能会从专业的角度展开讲讲 GA 的技术实现方法,太 tm 优雅了。。

1

defunct9 3h 26m ago

不优雅的地方:对 Linux 不友好,必须要装个 X-win ,弄好了 x-win ,又要弄个 py-win 的,不知道能不能开个 web 好了。为啥非要跑个窗口呢。

|

2

zzzzz024 3h 26m ago

只支持 api key 吗,订阅额度可以用吗

|

3

yesha 3h 22m ago

试试

|

4

h4nru1 OP @defunct9 为什么?你的 linux 有 python 环境直接 python agentmain.py 不就好了。。

|

7

stimw 3h 19m ago

> 测 Locomo 、LongtermMem 这几个数据集就是不合适的

这个能详细说说吗 |

8

fj19 3h 18m ago

这算是广告吗

|

9

h4nru1 OP @stimw 这些数据集里的数据都是 user-assistant 的对话堆起来的,然后让模型去 recall 用户提及的细节、偏好等等;但是现在 agent 的模式是任务式的,user 说一句,assistant 要跑好几十轮,召回的主体也从用户细节变成了任务细节(实现 task 中的某个具体步骤)。那原先的测评明显就不合适了。。

|

11

defunct9 2h 56m ago

折腾了半小时,放弃了。滚回去用了 hermes 。

|

12

Dream4U 2h 47m ago 对这种一边贬低别人,一边自己牛逼吹得山响的项目,直接拉黑,试都不会试。

|

13

giter 2h 45m ago

上联:拳打 Claude Code

下联:脚踢 Codex 横批:牛逼坏了 |

17

QAZXCDSWE 1h 52m ago

有没有想过一个问题,这么牛逼 A\都融资超过上千亿美元了,这项目是不是要国家队接见?

|

18

HFX3389 1h 48m ago

agent 类太多了,官方的 CC CX ,还有 pi warp ,再加上这个

|

19

h4nru1 OP |

20

thet 1h 43m ago

用起来也太麻烦了

|

21

h4nru1 OP |

23

K332 1h 40m ago

就是一个插件吧,核心功能还是其他三方模型,只是这个插件的优势是能省 token 和自己总结使用记录写 skill 。

另外 v 站发帖图床不用买啊,默认用 imgur 的就行了。 |

25

teaguexiao 1h 33m ago

用了半年 claude code 最大的感受是它的 context 管理和记忆机制确实是硬伤,每次开新会话都要重新喂背景,GA 的连续学习机制看起来确实解决了这个痛点。去看看这个项目,感谢分享!

|

26

K332 1h 31m ago

@h4nru1 #24 额,这个省 token 是因为上下文不到 30k ,但是现在的 token 缓存计费很低,输入输出高,所以实际上这个看上去消耗 token 少,但是真计费不一定比其他少。至于 skill 自进化这个可有可无吧,让 claude 自己总结历史写个 skill 也差不多的。

|

27

h4nru1 OP @K332 建议看技术报告的 2.1 章节。如果你感兴趣我可以再开一篇帖子详细讲讲。推荐你看一下这三篇论文: https://arxiv.org/abs/2307.03172

https://arxiv.org/abs/2410.18745 https://arxiv.org/abs/2302.00093 上下文长度的选择不光是从成本的角度考虑。 |

28

horizon 1h 22m ago

top3 是哪所大学

|

30

superares 1h 15m ago via Android

不支持订阅,还要自己弄反代的就不考虑了

|

31

testboy 1h 8m ago 推广就直接说推广。。对,你是博士,这个是复旦开发的,是吧。。

牛。。真牛就用不着到处找人发水贴了。 |

32

rtv 1h 0m ago

评价讨厌靠贬低别人来抬高自己,在 op 眼里就是跪久了,很好奇在 op 眼里是不是和你不一样就是跪?

|

33

utodea 57 mins ago

DeepSeek 的缓存命中率还挺高的,高强度用了一阵子感觉价格还能接受。 我也在写一个 deepseek-cli , 看看你这个是咋省 token 、自进化的,学习下。

https://github.com/usewhale/whale |

34

Justin13 54 mins ago via Android

模型原厂的优化和 token 价格是三方难以比拟的

比如 codex plus 20 刀,但你如果按 api 价格算每月能用到 200 刀 这怎么比?所以三方的我全都不用了,cusor 也准备退了 而且 codex 进化的非常快,你提到的记忆,电脑使用,浏览器使用也都支持了 对我来说最划算的就是开两个 plus,每月 250 一个上最新模型解决复杂长注意力任务,5 小时内也就干 2,3 个吧 另一个上 5.3 codex,日常任务完全胜任,非常耐用 |

35

yinanc 51 mins ago

嘉豪

|

36

herozzm 50 mins ago

软文

|

37

wubajie 38 mins ago

软文

|

38

Razio 36 mins ago

牛逼哥,我只想说,工作是工作,论文是论文。说的再天花乱坠,大家上个 B 班,该用啥还是用啥。

打比方,Claude 模型大家公认,你突然来个 Abc ,吊打 Claude ,不做评价,只是说在大家口口相传之前,没人会搭理你 Abc |

39

xingyue 31 mins ago via Android

单轮上下文确实短,但是也有问题,稍微复杂点的问题能整出几百轮然后死循环最后也解决不了问题,实测下来,用来做编码 agent 并不好用。

|

40

darksword21 PRO 你是博士≠你说的对

不好意思有点怀疑你 top3 博士的真实性(我是学渣),但是你确实有种认知低下的美 |